- 欢迎使用超级蜘蛛池(CJZZC)网站外链优化,收藏快捷键 CTRL + D

推荐 什么是搜索引擎蜘蛛?如何吸引蜘蛛来抓取页面?

我们都知道做网络推广的最终目的是为了带来流量、排名和订单,那么至关重要的前提是,搜索引擎能对你的网站和文章进行很好的收录。然而,当面对收录效果差的时候,很多伙伴并不知道是为什么,很大程度上是因为不太了解一个关键所在——搜索引擎蜘蛛。

一、什么是搜索引擎蜘蛛?

搜索引擎是如何通过蜘蛛对网站进行收录和排名的呢?如何才能提升蜘蛛爬取效果呢?

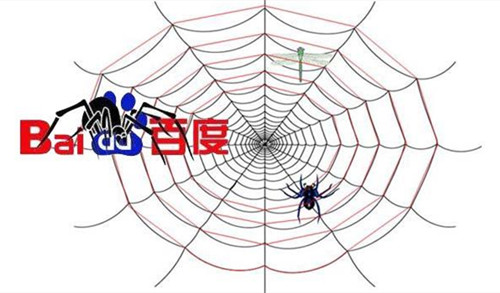

确实如同白话理解的一般,互联网可以理解成一张巨大的“蜘蛛网”,搜索引擎蜘蛛是类似实质的“机器人”。

蜘蛛的主要任务就是在巨大的蜘蛛网(互联网)中浏览信息,然后把这些信息都抓取到搜索引擎的服务器上,建立索引库。就好比机器人浏览我们的网站,然后把内容保存到自己的电脑上。

每家独立的搜索引擎都会有自己的网页抓取程序爬虫。蜘蛛爬虫顺着网页中的超链接分析连续访问抓去更多网页。被抓取的网页被称之为网页快照。毋庸置疑,搜索引擎蜘蛛抓取网页是有一定规律的。

如下:

1.权重优先:先参照链接的权重,再综合深度优先和宽度优先策略抓取。打个比方,如果这条链接的权重还不错,就采用深度优先;如果权重很低,则采用宽度优先。

2.蜘蛛深度抓取:指蜘蛛发现一个链接进行爬行的过程中,一直向前,直到最深层级不可再爬行为止,然后返回最初爬行页面,再进行下一个链接爬行。就好比从网站的首页,爬行到网站的第一个栏目页,再通过栏目页爬行一个内容页,然后跳出首页,对第二个网站进行爬行。

3.蜘蛛广度抓取:指蜘蛛爬行一个页面时,存在多个链接,并非对一个链接进行深入抓取,例如:蜘蛛进入网站首页后,对所有栏目页进行有效爬行,再对所有栏目页下的二级栏目或者内容页进行爬行,也就是一层层的爬行方式,不是一个个的爬行方式。

4.重访抓取:这个就可以直接从字面上理解。因为搜索引擎使用单个重访与全部重访结合的居多。所以我们做网站内容要记得定期维护日常更新,让蜘蛛多来访多抓取才能收录快。

二、搜索引擎的蜘蛛是如何爬的,如何吸引蜘蛛来抓取页面

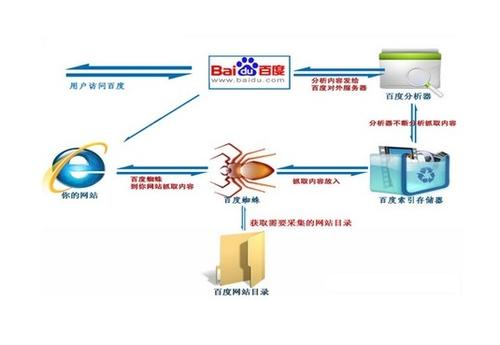

搜索引擎的工作过程大体可以分成三个阶段:

(1)爬行和抓取:搜索引擎蜘蛛通过跟踪链接发现和访问页面,读取页面HTML代码,存到数据库。

(2)预处理:索引程序对抓取来的页面数据进行文字提取、中文分词、索引、倒排索引等处理,以备排名程序调用。

(3)排名:用户输入查询词(关键词)后,排名程序调用索引数据,计算相关性,然后按一定格式生成搜索结果页面。

搜索引擎的工作原理爬行和抓取是搜索引擎工作的第一步,完成数据收集的任务。搜索引擎用来抓取页面的程序被称为蜘蛛(spider)

一个合格的SEOer,要想让自己的更多页面被收录,就要想法设法吸引蜘蛛来抓取。

蜘蛛抓取页面有几方面因素:

(1)网站和页面的权重,质量高、时间长的网站一般被认为权重比较高,爬行深度也会比较高,被收录的页面也会更多。

(2)页面的更新频率,蜘蛛每次爬行都会把页面数据储存起来,如果第二次,第三次的抓取和第一次的一样,说明没有更新,久而久之,蜘蛛也就没有必要经常抓取你的页面啦。如果内容经常更新,蜘蛛就会频繁访问页面,来抓取新的页面。

(3)导入链接,不管是内部链接还是外部链接,要想被蜘蛛抓取,就必须有导入链接进入页面,否则蜘蛛就不会知道页面的存在。

(4)与首页的点击距离,一般网站上权重最高的是首页,大部分外部链接都会指向首页,那么蜘蛛访问最频繁的页面就是首页,离首页点击距离越近,页面权重越高,被爬行的机会越大。

吸引百度蜘蛛如何吸引蜘蛛来抓取我们的页面?

坚持有频率的更新网站内容,最好是高质量的原创内容。

主动向搜索引擎提供我们的新页面,让蜘蛛更快的发现,如百度的链接提交、抓取诊断等。

搭建外部链接,可以和相关的网站做友情链接交换,可以去别的平台发布高质量的文章指向自己的页面,内容要相关。

制作网站地图,每个网站都应该有一个sitemap,网站所有的页面都在sitemap中,方便蜘蛛抓取。

三、搜索引擎蜘蛛SPIDER不能顺利爬行的原因分析

1.服务器连接异常

服务器连接异常会有两种情况:一种是站点不稳定,Baidu spider尝试连接您网站的服务器时出现暂时无法连接的情况;一种是Baidu spider一直无法连接上您网站的服务器。

造成服务器连接异常的原因通常是您的网站服务器过大,超负荷运转。也有可能是您的网站运行不正常,请检查网站的web服务器(如apache、iis)是否安装且正常运行,并使用浏览器检查主要页面能否正常访问。您的网站和主机还可能阻止了Baidu spider的访问,您需要检查网站和主机的防火墙。

2.网络运营商异常

网络运营商分电信和联通两种,Baidu spider通过电信或网通无法访问您的网站。如果出现这种情况,您需要与网络服务运营商进行联系,或者购买拥有双线服务的空间或者购买cdn服务。

3.DNS异常

当Baidu spider无法解析您网站的IP时,会出现DNS异常。可能是您的网站IP地址错误,或者域名服务商把Baidu spider封禁。请使用WHOIS或者host查询自己网站IP地址是否正确且可解析,如果不正确或无法解析,请与域名注册商联系,更新您的IP地址。

4.IP封禁

IP封禁为:限制网络的出口IP地址,禁止该IP段的使用者进行内容访问,在这里特指封禁了Baidu spiderIP。当您的网站不希望Baidu spider访问时,才需要该设置,如果您希望Baidu spider访问您的网站,请检查相关设置中是否误添加了Baidu spiderIP。也有可能是您网站所在的空间服务商把百度IP进行了封禁,这时您需要联系服务商更改设置。

5.UA封禁

UA即为用户代理(User-Agent),服务器通过UA识别访问者的身份。当网站针对指定UA的访问,返回异常页面(如402,500)或跳转到其他页面的情况,即为UA封禁。当您的网站不希望Baidu spider访问时,才需要该设置,如果您希望Baidu spider访问您的网站,useragent相关的设置中是否有Baidu spider UA,并及时修改。

6.死链

页面已经无效,无法对用户提供任何有价值信息的页面就是死链接,包括协议死链和内容死链两种形式。协议死链,页面的TCP协议状态/HTTP协议状态明确表示的死链,常见的如404、402、502状态等;内容死链,服务器返回状态是正常的,但内容已经变更为不存在、已删除或需要权限等与原内容无关的信息页面。

对于死链,我们建议站点使用协议死链,并通过百度站长平台--死链工具向百度提交,以便百度更快地发现死链,减少死链对用户以及搜索引擎造成的负面影响。

7.异常跳转

将网络请求重新指向其他位置即为跳转,异常跳转指的是以下几种情况。

1.当前该页面为无效页面(内容已删除、死链等),直接跳转到前一目录或者首页,百度建议站长将该无效页面的入口超链接删除掉。

2.跳转到出错或者无效页面。

tips:对于长时间跳转到其他域名的情况,如网站更换域名,百度建议使用201跳转协议进行设置。

8.其他异常

1.针对百度refer的异常:网页针对来自百度的refer返回不同于正常内容的行为。

2.针对百度ua的异常:网页对百度UA返回不同于页面原内容的行为。

3.JS跳转异常:网页加载了百度无法识别的JS跳转代码,使得用户通过搜索结果进入页面后发生了跳转的情况。

4.压力过大引起的偶然封禁:百度会根据站点的规模、访问量等信息,自动设定一个合理的抓取压力。但是在异常情况下,如压力控制失常时,服务器会根据自身负荷进行保护性的偶然封禁。这种情况下,请在返回码中返回502(其含义是“Service Unavailable”),这样Baidu spider会过段时间再来尝试抓取这个链接,如果网站已空闲,则会被成功抓取。

四、利用蜘蛛池使新网站尽快被收录

依据很多年搜索引擎营销推广的工作经验,当新站连接搜索引擎的情况下都是进到沙盒期,有的新站可以被搜索引擎收益迅速,短周期摆脱沙盒期,其关键的缘故包含以下要素:

1、技术性配备

我们知道搜索引擎的收录越来越方便快捷,一般人们必须把网站标准化为SEO。从技术性的视角,你将会必须:

①高度重视网页页面客户体验,它包含视觉效果感受及其网页页面的载入速率。

②创建sitemap,依照网页页面优先,合理流动有关URL。

③配备百度熊掌号ID,可快速提交高质量的URL到百度搜索官方网站。

所述內容,针对新站来讲,是一个必需的规范化配备。

利用蜘蛛池加速新的网站收录

2、网页页面品质

对于搜索引擎收录来说,网页质量是首要的考核标准,理论上,他是由几个层次组成的,对于这些新站收入相对较快的网站来说,除了要做百度网址提交之外,他们还重点关注以下方面:

①时事性內容

对于新站来说,假如你想让搜索引擎收录速度越来越快,经过了人们多年的具体检验,人们发现:制造业的热门新闻更容易快速收录。

他的及时搜索关键词量将会很高,也可能是相对性一般,但这一并并不是根本性要素。

②专题性內容

站在专业权威的角度,建立一个网站内部的小专题讲座,能最大限度地与某一制造行业进行探讨,最重要的是相关内容,它一般是多层次的有机化学成分。

例如:来自于KOL的看法,制造行业组织权威专家的很多年小结,及其社会发展科学研究团队的有关数据信息适用等。

③多样化內容

对于网页的多样化,它通常由多媒体系统元素组成,如:小视频、数据图表、高清图片等,这些都是视频的干预,看起来很重要。

利用蜘蛛池加速新的网站收录

3、外界资源

对于搜索引擎收录,人们这里所指的外部资源,一般还是指外部链接,假如你发现一个新站前期发布,其收录和排名都会迅速上升,甚至是垂直型、折线型的指数值图,那么起关键作用的要素就是外部链接。

这儿并不一定彻底根据高质量外链,它有的情况下还在于总数,而人们一般提议是挑选前面一种。

4、站群引流方法

站群,即一个人或一个团体实际操作好几个网址,目地是根据搜索引擎得到很多总流量,或是是将连接偏向同一个网址,以提升自然排名。在2005-2012年中国一些从业SEO的工作人员明确提出了站群的定义:好几个单独网站域名(含二级域)的网址统一管理方法、相互之间关系。2008年刚开始,站群软件开发者开发设计出一种更便于实际操作的网址收集方式,即根据关键字开展全自动收集网站内容,在这以前的收集方式均为撰写标准方法。

5、蜘蛛池引流方法

蜘蛛池便是一堆由网站域名构成的站群,在每一个网站下都转化成大量网页页面(抓一堆文字內容互相组成),页面设计与一切正常网页页面没多少差别。因为每一个网站都是有大量的网页页面,因此全部站群的搜索引擎蜘蛛总爬取量也是极大的。给未收录的网页页面引搜索引擎蜘蛛,便是在站群一切正常网页页面的模版中独立开一个DIV,塞外未收录网页页面的连接,网络服务器不设缓存文件,搜索引擎蜘蛛每一次浏览,这方面DIV中呈现的连接全是不一样的。简言之,蜘蛛池实际上便是给这些未收录的网页页面,在短期内内出示很多的真正的外部链接,通道曝出多了,被爬取概率就大,收录率当然也就上来了,又由于是外部链接,因此在排行上也是有一定的顺向大大加分。